Nettoyer, transformer et enrichir des données provenant de diverses sources hétérogènes n’est pas toujours simple, même en tant qu’analyste de données. Qui n’a jamais jonglé entre des données incomplètes, mal formatées ou parsemées d’erreurs ? Été confronté à un volume massif de données à traiter avec des délais serrés ? Ou bien à un manque de consolidation de données pour assurer une vue d’ensemble et des analyses précises ?

C’est là qu’intervient une des fonctionnalité clés de ClicData, le module Data Flow. Vous ne le connaissez pas encore ? Il vous permet de manipuler tout type de données, comme vous le souhaitez. Fusionnez, joignez, nettoyez, enrichissez et regroupez vos données pour qu’elles soient prêtes à être visualisées dans des rapports ou tableaux de bord. Le tout, sans codage pré-requis. On vous explique comment ?

Comment fonctionne Data Flow : Une vue d’ensemble de vos transformations

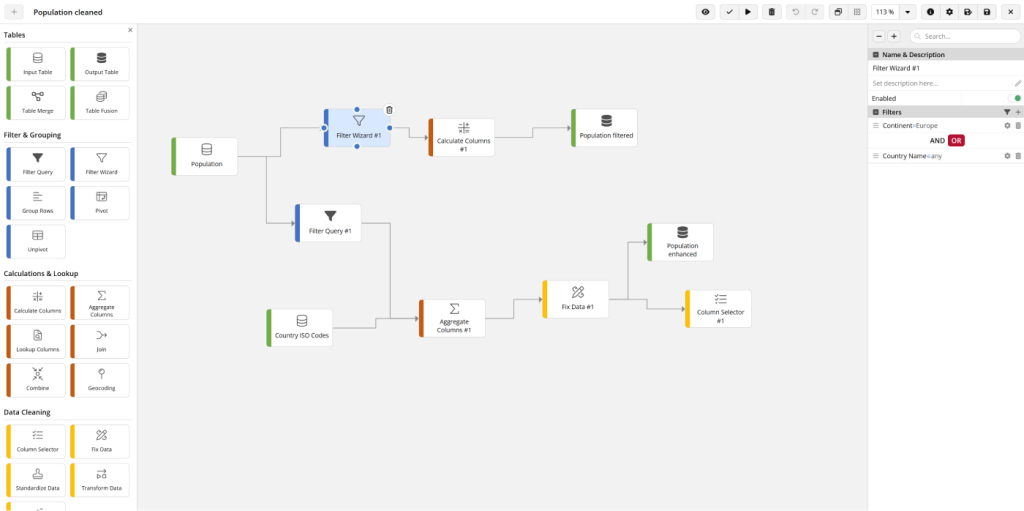

Eh oui, son nom est un indice : vous construisez, visuellement, vos flux de A à Z avec Data Flow. Cela signifie que toutes les opérations de nettoyage des données, de calculs… se déroulent dans une interface visuelle unique où chaque étape peut être facilement documentée et comprise par tous les utilisateurs.

Plutôt intéressant, non ?

De la table d’entrée aux tables de sortie, créez une suite continue de nœuds interconnectés qui transforment vos données, étape par étape, avec de simples glisser-déposer. On vous montre comment concrètement avec des exemples ?

Accélérez et optimisez votre traitement de données avec Data Flow

Vous l’aurez compris, ce module peut être utilisé pour divers cas d’usage. Découvrons deux exemples pour un traitement de données plus efficace :

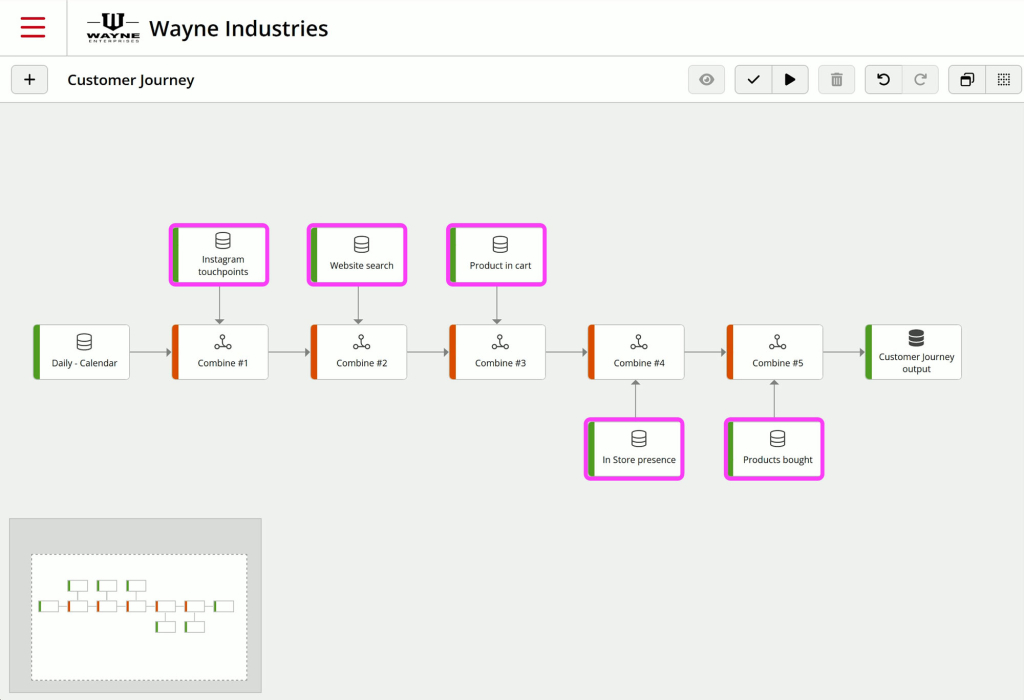

1. Combler les lacunes dans le parcours client avec des données unifiées

Mettons nous à la place de Ravi, Responsable Marketing souhaitant obtenir une meilleure compréhension de l’ensemble de son parcours client à travers ses différents magasins.

La marque pour laquelle il travaille possède 10 magasins physiques et un site e-commerce.

Ravi souhaite répertorier chaque point de contact, pour chaque client afin de connaître les activités telles que :

- la manière dont les clients interagissent avec la marque sur les réseaux sociaux,

- les produits qu’ils recherchent sur le site internet,

- ceux qu’ils ajoutent à leur panier mais n’achètent pas,

- s’ils ont des interactions avec le personnel en magasin,

- ou bien en ligne via un chat,

- ce qu’ils achètent, etc…

Avec un Data Flow agrégeant les données des différentes sources dans une seule table de sortie, vous avez désormais une vue d’ensemble complète de chaque point de contact des prospects et clients de Ravi à travers tous les magasins de la marque.

Vous pouvez à présent, utiliser ces données unifiées pour créer un tableau de bord afin que Ravi réalise une analyse précise du parcours client. Il pourra aussi, s’il le souhaite, les ajouter dans son CRM afin de diffuser des publicités plus pertinentes auprès de ses clients et prospects.

Vous avez répondu à la problématique métier de Ravi qui peut désormais analyser l’ensemble de son parcours client.

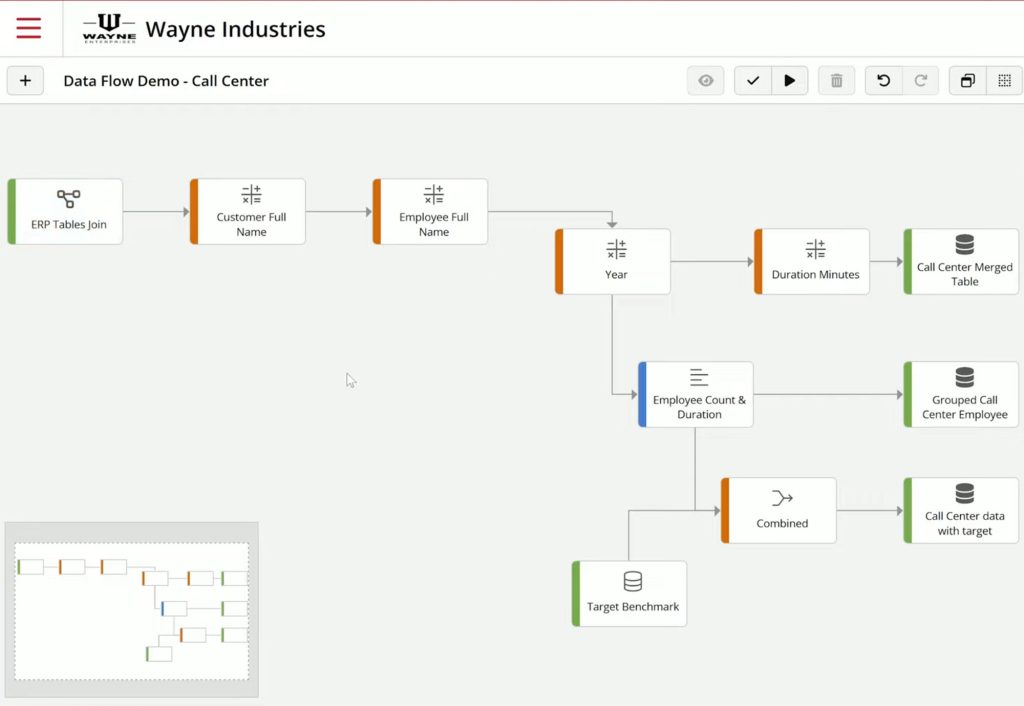

2. Suivre les performances d’un centre d’appel avec des données enrichies

Pour cet exemple, mettons nous dans la peau d’Hanako, Responsable d’un centre d’appels souhaitant suivre les performances de plusieurs centres d’appels au niveau global et par employé ainsi que par rapport à différentes cibles.

Pour répondre à sa problématique, Data Flow vous permet de créer une fusion pour relier les données des 4 tables de son ERP entre elles comprenant :

- les appels,

- les salariés,

- les clients,

- et les entreprises

Puis après quelques transformations pour nettoyer et ajouter de nouvelles colonnes calculées, vous êtes en mesure de créer 3 tables de sorties affichant :

- l’ensemble des appels,

- les appels regroupés par employé,

- et les performances sont agrégées avec les objectifs correspondants

Il ne reste plus qu’à automatiser le traitement de ce Data Flow et à alimenter ces données, dans un tableau de bord, comme celui-ci.

Encore une problématique métier résolue !

Hanako peut désormais suivre l’ensemble de ses KPIs, heure par heure, pour mesurer la performance globale de ses centres d’appels par rapport aux objectifs, les performances individuelles des employés, etc…

Avec Data Flow, manipulez tout type de données, comme vous le souhaitez et optimisez votre traitement de données : aussi bien les tâches simples que complexes.

Un panel complet d’outils de traitement de données pour des possibilités infinies

Parce que vous pouvez créer autant de tables de sortie que nécessaire à partir de différentes tables d’entrée dans un flux comprenant des branches multiples, vous avez la flexibilité d’exécuter simultanément différentes transformations.

Celles-ci peuvent se faire en même temps, soit en parallèle ou en séquence, assurant ainsi une mise à jour simultanée de vos données. Ainsi, les étapes de gestion secondaires comme la création de vues, les fusions ou le maintien d’une convention de dénomination claire ne sont plus nécessaire.

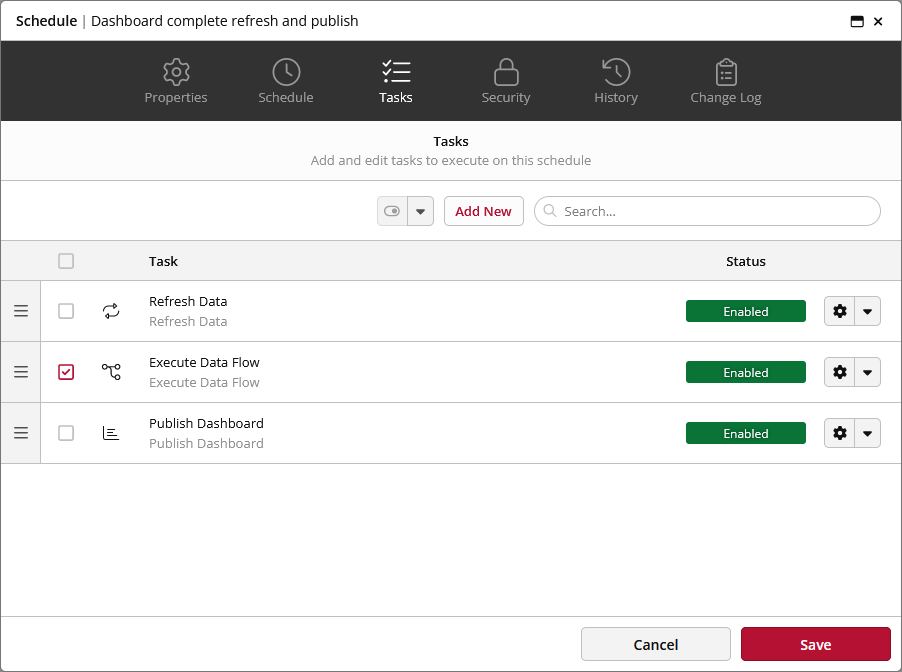

Une exécution des flux de données selon vos besoins

Un Data Flow s’exécute selon vos besoins : soit selon un planning prédéfini, soit à votre demande. Cela signifie que vous pouvez le programmer pour charger plusieurs ensembles de données et préparer les nouvelles données pour l’analyse ou la visualisation seulement lorsque vous êtes prêt.

Vous pouvez prévisualiser le flux avant de l’exécuter réellement, garantissant que tout problème soit résolu en amont.

Un traitement des données plus performant

Imaginez les flux de données comme le processus de cuisson d’un plat : vous prenez des ingrédients (les données de tables physiques), les cuisinez (les traitez dans le flux de données), puis servez le plat fini (stockez les résultats dans des tables de fin).

Les flux de données construisent toujours des données sur des tables qui ne nécessitent pas d’être recalculées ou retraitées, à chaque utilisation, dans des tableaux de bord ou des rapports.

Plus besoin de vous soucier de certaines tâches complexes comme la gestion du cache ou la vérification des dépendances.

Les nœuds (ou les étapes du processus de transformation) sont conçus avec différentes techniques comme :

- les Table d’Expression Commune (CTE),

- la création automatique de jointures pour des agrégations rapides,

- l’utilisation d’index en colonnes,

- et bien plus encore

Des séquences logiques pour des traitements plus complexes

Vous pouvez organiser vos flux de données, les uns après les autres afin de construire des groupes pour traiter vos données de manière organisée.

Par exemple, vous pouvez avoir un premier flux qui nettoie les données et normalise le schéma de sortie.

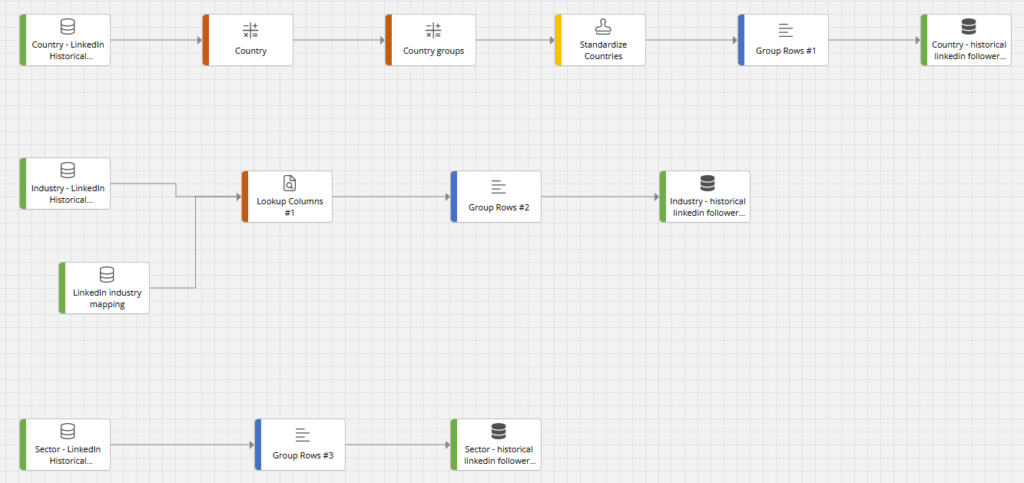

Prenons l’exemple de 3 dimensions LinkedIn qui sont préparées pour un traitement ultérieur (nous travaillons ici avec le nombre d’abonnés mensuel par pays, industrie et secteur). Ce flux a été exécuté une seule fois, car il concerne des données historiques qui ne changeront plus, par la suite. C’est un peu comme ordonner vos épices dans des boîtes par pays, afin de les retrouver facilement quand vous en avez besoin !

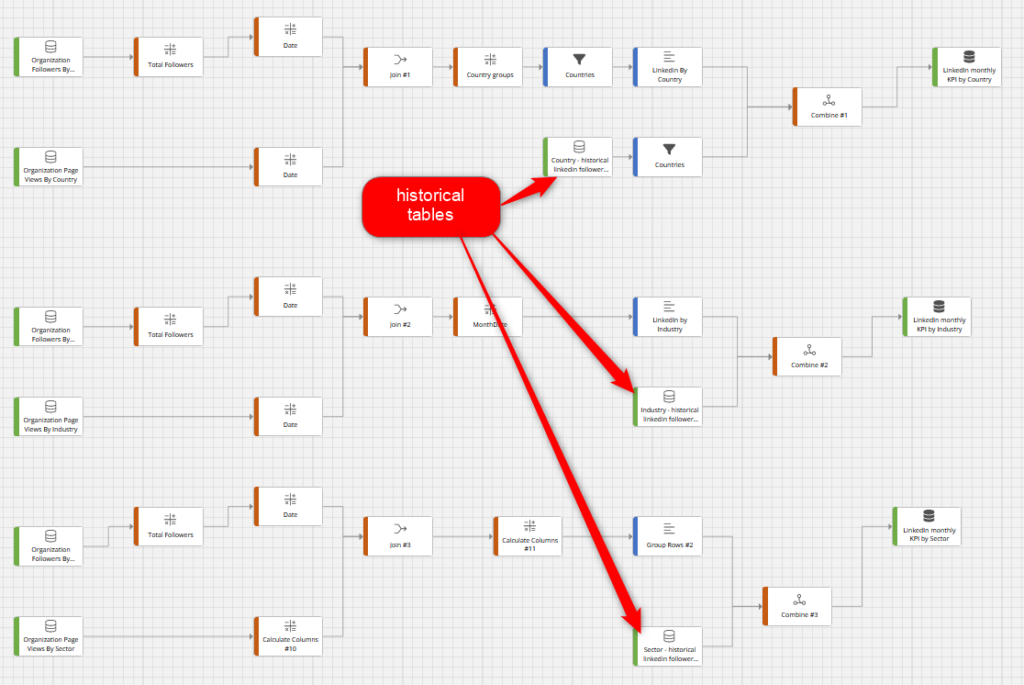

Ensuite, un deuxième flux peut utiliser la table de sortie pour calculer des métriques standard pour divers rapports et tableaux de bord.

Dans notre cas, les données en temps réel sont traitées pour les 3 dimensions des abonnés LinkedIn, dans le flux ci-dessous et seront ensuite combinées avec les résultats historiques du premier flux de données.

Vous pouvez éventuellement créer un troisième flux pour pré-grouper ou pré-agréger certain flux précédents.

Cela permet de maintenir le traitement des données de manière claire et modulaire, tout en identifiant simultanément des zones d’amélioration pour de meilleures performances.

Une collaboration fluide avec tous les membres de votre équipe

Étant donné que toutes les opérations de transformation sont regroupées dans un unique flux de données, il devient alors très simple de partager des flux avec d’autres utilisateurs, de créer des copies de processus ou de simplement changer les tables d’entrée et/ou de sortie au besoin.

Chaque nœud peut recevoir un nom et une description spécifique, facilitant ainsi la compréhension du traitement des données avec un minimum d’efforts de documentation.

Et la sécurité dans tout ça ? Elle reste dans notre ADN, les utilisateurs peuvent être des éditeurs ou des spectateurs, ou n’avoir accès à certains ou à tous les flux de données.

Prêts à adopter Data Flow ?

Simplifier votre quotidien d’analyste devient une réalité avec Data Flow. Manipulez tout type de données, comme vous le souhaitez !

Libérez-vous des contraintes pour fusionner, joindre, nettoyer, enrichir et regrouper vos données, les préparant à être visualisée dans des tableaux de bord et rapports percutants.

Testez Data Flow dès maintenant en lançant vos deux semaines d’essai gratuit !