Nous passons beaucoup de temps à échanger avec des équipes data dans des entreprises mid-market, et presque chaque conversation tourne autour d’une même problématique récurrente. Un responsable analytics mentionnera, presque comme une anecdote, qu’il a perdu deux jours la semaine dernière à faire concorder trois sources de données avant même de pouvoir construire le dashboard que son VP lui avait demandé. Google Ads exportait les dates en chaînes de caractères brutes plutôt qu’en valeurs de type date, Salesforce utilisait le format MM/JJ/AAAA tandis que l’entrepôt de données attendait JJ/MM/AAAA (ce qui transformait régulièrement le 3 janvier en 1er mars). Pendant ce temps, les horodatages Shopify portaient des décalages de fuseau horaire qui variaient selon l’emplacement du magasin ayant généré la commande. Quelques doublons de clients s’étaient glissés parce que le même client s’appelait « Acme Corp » dans un système et « ACME Corporation » dans un autre. Deux jours de travail sans aucune valeur analytique, et le cycle recommence le lundi suivant.

La préparation des données assistée par IA change ce qui vient après cette conversation, mais pas tout à fait comme le laissent entendre la plupart des présentations commerciales.

La vraie valeur ne réside pas dans le fait que le nettoyage s’exécute plus vite (c’est le cas, mais c’est la partie triviale) elle réside dans le fait que votre équipe accède à des capacités qu’elle n’aurait jamais développées seule : une logique d’enrichissement qui s’exécute au niveau de la ligne au sein d’un pipeline planifié, des contrôles qualité qui signalent une dégradation avant qu’un ticket ne soit ouvert et des suggestions de transformations que la plateforme génère en reconnaissant des patterns dans vos données.

Cet article s’adresse aux équipes mid-market pour lesquelles la préparation manuelle des données grève réellement les marges, sans pour autant disposer d’une équipe d’ingénierie data dédiée à chaque pipeline. Nous avons construit ClicData pour résoudre ce problème, nous avons donc un point de vue dans cette comparaison, mais nous savons aussi qu’aucun outil n’est universel, et ce guide le reflète.

Vue d’ensemble

- La préparation domine encore le cycle de vie analytique. Les études estiment que les analystes consacrent entre 40 % et 80 % de leur temps à la préparation des données, et le marché des outils de nettoyage de données devrait passer de 3,62 milliards à 4,23 milliards de dollars cette année, avec une croissance annuelle de 17 % (The Business Research Company, 2026). Ce n’est pas un marché qui existerait si le problème avait été résolu.

- L’IA élève le niveau de ce que votre équipe data peut accomplir, bien au-delà d’une simple accélération du nettoyage. Les nouveaux jeux de données sont profilés en quelques secondes plutôt qu’en une demi-journée, les anomalies remontent à la surface avant que quiconque ne pense à les chercher, et les workflows d’enrichissement qui nécessitaient auparavant un sprint complet peuvent désormais s’exécuter en planifié.

- La plupart des équipes confondent « data analytics » et « data intelligence » et cette confusion a des conséquences concrètes sur leurs investissements. L’un est rétrospectif : voici ce qui s’est passé au T3. L’autre exploite l’IA et le machine learning pour anticiper ce qui arrive et le signaler avant même qu’un humain pose la bonne question.

- ClicData couvre davantage de l’end-to-end dans un seul produit que toute autre plateforme de ce comparatif, sans middleware, sans export entre outils. Chaque handoff supprimé est un point de défaillance que vous n’aurez pas à déboguer un dimanche soir.

- Commencez votre évaluation là où la douleur est la plus forte. Si les incohérences de formats de dates continuent de monopoliser vos lundis matin, le nettoyage automatisé est le premier investissement à réaliser. Si vos pipelines tournent déjà en planifié mais que personne n’en extrait encore de valeur prédictive, c’est la couche d’augmentation par IA qui mérite votre attention.

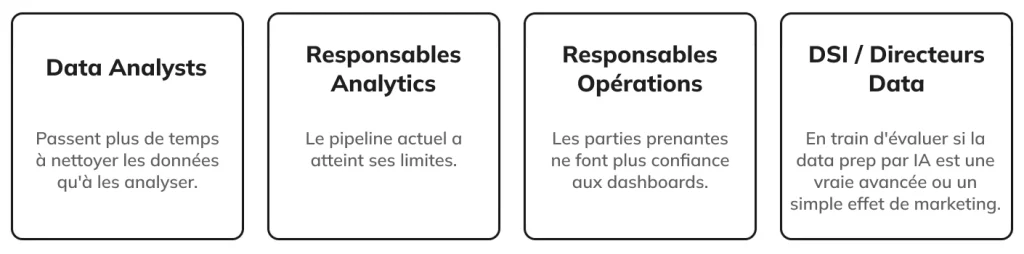

A qui est-ce que ça s’adresse :

Qu’est-ce que la Préparation des Données et Pourquoi Prend-elle Encore Autant de Temps ?

La préparation des données, c’est le travail qui s’intercale entre la donnée brute et la donnée prête à l’analyse, ce qui concrètement signifie : collecter, nettoyer, transformer, enrichir et charger les données dans un endroit où quelqu’un peut en faire quelque chose d’utile. Le guide ClicData sur l’intégration des données explique comment la partie ingestion de ce workflow s’articule. La définition est simple. Si elle consomme autant du cycle de vie analytique, c’est parce qu’elle doit être réalisée en continu, et que chaque source de données que votre entreprise connecte arrive avec ses propres conventions de formatage, jamais conçues pour être compatibles avec celles des autres.

Le chiffre le plus souvent cité est que les professionnels de la data passent 80 % de leur temps sur la préparation. Les enquêtes Crowdflower menées entre 2015 et 2017, qui ont généré ce chiffre, situaient en réalité le nettoyage entre 50 % et 67 % une fois décompté le temps de collecte. Environ 60 % des professionnels de la data citent encore la saisie manuelle comme source significative d’erreurs (DataStackHub, 2025), ce qui montre que les constructeurs de pipelines visuels et les plateformes ETL censés résoudre ce problème n’ont fait, pour l’essentiel, que déplacer le goulot d’étranglement.

La raison pour laquelle personne n’y échappe, c’est que les sources de données prolifèrent plus vite qu’aucune équipe ne peut les standardiser. Chaque nouvelle plateforme connectée arrive avec ses propres conventions de dates, son propre formatage des devises, et sa propre définition, discrètement unique, de ce que « chiffre d’affaires » ou « client » devrait signifier. Et comme ces incohérences se répètent à chaque cycle de rafraîchissement, votre équipe finit par corriger les mêmes problèmes semaine après semaine, à moins qu’un pipeline de préparation automatisée ne les absorbe.

À quoi ressemble un workflow typique de nettoyage de données ?

Prenons une entreprise e-commerce mid-market qui consolide chaque semaine les données de Google Ads, Salesforce et Shopify dans un dashboard de performance unique. Avant que l’analyste puisse construire un seul graphique, il est confronté à des champs de dates dans trois formats différents (AAAA-MM-JJ de Google, MM/JJ/AAAA de Salesforce, horodatages avec décalage de fuseau horaire de Shopify), des doublons de clients disséminés sur deux systèmes avec des orthographes légèrement différentes, des valeurs de dépenses publicitaires manquantes pour les semaines où certaines campagnes étaient en pause, et des chiffres de revenus impossibles à réconcilier parce que chaque plateforme a ses propres règles sur ce qui constitue du chiffre d’affaires. Quatre problèmes, et le dashboard n’a pas encore été ouvert. Le guide ClicData sur les cinq étapes essentielles du nettoyage des données explique en détail pourquoi ces problèmes spécifiques reviennent systématiquement.

Sur deux décennies, les outils sont passés des tableurs aux ETL scriptés puis aux pipelines visuels, chaque génération résolvant certains problèmes tout en en introduisant de nouveaux. Ce qui distingue les plateformes assistées par IA de tout ce qui a précédé, c’est qu’elles ne se contentent plus d’exécuter les tâches que vous avez déjà configurées, elles commencent à détecter des problèmes que votre équipe n’a pas encore rencontrés

Data Intelligence vs. Data Analytics : Quelle Différence, et Pourquoi Est-ce Important ?

Les termes data intelligence et data analytics sont souvent utilisés comme des synonymes, et cette confusion oriente les investissements des équipes dans leurs workflows de préparation souvent dans la mauvaise direction.

- Le data analytics, c’est ce que font la plupart des équipes aujourd’hui : nettoyer la donnée, la charger, construire des dashboards et interpréter ce qui s’est passé le trimestre dernier. Le rapport de chiffre d’affaires T3 sort, quelqu’un explique pourquoi les chiffres ont évolué, le marketing compare les campagnes, les opérations signale un pic de churn. Tout cela est utile et tout cela est rétrospectif. Le travail de préparation qui le sous-tend est également réactif : votre équipe nettoie les mêmes formats, corrige les mêmes doublons et réconcilie les mêmes définitions de revenus divergentes à chaque cycle de rafraîchissement, parce que le pipeline ne fait que ce pour quoi il a été configuré manuellement.

- La data intelligence transforme la relation entre préparation et analyse, parce que l’IA et le ML sont intégrés dans le pipeline lui-même. Au lieu de nettoyer la donnée pour qu’un humain puisse l’examiner plus tard, le pipeline commence à détecter : la détection d’anomalies repère une chute de revenus avant la revue de direction, un score de qualité signale qu’une source se dégrade avant qu’elle ne casse un dashboard en aval, et la plateforme suggère des transformations pour une nouvelle source de données parce que le schéma ressemble à quelque chose qu’elle a déjà traité. La couche de préparation cesse d’être un centre de coût et devient l’endroit où la génération d’insights commence réellement. Le guide ClicData sur IA vs. ML vs. BI explique comment ces différentes couches s’articulent entre elles.

La conséquence concrète est que votre investissement dans la préparation des données détermine de quel côté de cette ligne de démarcation vous vous trouvez. Si vos pipelines se contentent de nettoyer et de charger, vous restez en mode analytics quelle que soit la qualité de vos dashboards. Si vos pipelines profilent, enrichissent, détectent et suggèrent, vous avez basculé dans la data intelligence. Mais ne tentez pas ce saut avant que les fondations soient solides. Si « chiffre d’affaires » signifie encore trois choses différentes selon trois départements, ou si des rafraîchissements échouent silencieusement sans que personne ne le remarque, ces problèmes doivent être résolus en priorité. L’article ClicData sur la construction de fondations data solides pour la BI couvre exactement ce sujet. La prédiction construite sur de mauvaises données ne fait que produire des réponses erronées avec davantage de conviction.

Comment l’IA Redéfinit-elle la Préparation des Données en 2026 ?

Il existe un écart significatif entre ce que promettent les supports commerciaux des éditeurs en matière de préparation des données par IA et ce qui fonctionne réellement en production. Voici donc un état des lieux honnête du marché.

La capacité la plus fiable à l’heure actuelle, celle qui fonctionne de manière cohérente sur la plupart des outils sérieux de data integration par IA est le profilage automatisé. Vous soumettez un nouveau jeu de données au moteur et en quelques secondes il vous dit ce qu’il observe : types de colonnes, distribution statistique, détection de valeurs aberrantes et flags de qualité. Ce type d’analyse prenait auparavant une demi-journée d’exploration SQL. Parallèlement, l’automatisation du nettoyage est devenue véritablement performante : le problème classique où « New York », « NY », « new york » et « N.Y. » désignent tous le même endroit est résolu par reconnaissance de patterns, et la déduplication par fuzzy matching détecte des enregistrements qu’une simple requête DISTINCT manquerait complètement.

Le mapping de schémas est là où l’expérience devient inégale. Les meilleures plateformes analysent une nouvelle source, la comparent à votre entrepôt et suggèrent comment aligner les colonnes, certaines recommandent même des transformations basées sur des précédents. Le point faible reste la logique métier : si votre entreprise calcule le chiffre d’affaires net d’une façon non conventionnelle, l’IA n’a aucun moyen de le déduire d’un simple en-tête de colonne et suggèrera quelque chose qui semble juste mais ne l’est pas. Un regard humain sur ces suggestions reste indispensable.

La requête en langage naturel fonctionne pour des questions d’exploration simples et s’effondre dès qu’on lui demande d’effectuer un vrai travail sur des pipelines. La préparation en self-service guidée par des recommandations IA est la frontière active du marché, et l’écart de qualité entre plateformes est franchement considérable.

Sur l’adoption, le dbt Labs 2025 State of Analytics Engineering Report indique que 80 % des praticiens de la data utilisent désormais l’IA quotidiennement dans leur travail, contre 30 % l’année précédente, même si l’essentiel de cet usage relève de l’assistance au code et de la documentation plutôt que de l’automatisation complète de pipelines. Un rapport Global Growth Insights (2025) estime séparément qu’environ 43 % des workflows de préparation des données en entreprise intègrent désormais une forme d’automatisation basée sur l’IA.

Les Principales Plateformes de Préparation des Données Assistée par IA

Aucune plateforme ne gagne sur toutes les dimensions, et quiconque vous affirme le contraire vous vend quelque chose. Voici une analyse honnête de six plateformes dignes d’évaluation, chacune avec de véritables points forts et des compromis qui comptent selon la taille de votre équipe, sa maturité technique et l’emplacement réel de vos données.

Nous présentons ClicData en premier non pas parce qu’il devance chaque concurrent sur chaque dimension individuelle, mais parce qu’aucun autre outil dans ce comparatif ne résout aussi complètement le problème de la multiplication des outils. Le module Data Flow offre un éditeur de pipeline visuel avec plus de 35 nœuds, dont des nœuds de nettoyage dédiés (standardisation des données, correction de format, déduplication) et des nœuds de traitement assistés par IA (propulsés par Azure OpenAI) intégrés directement dans le flux. Data Scripts propose des environnements d’exécution Python 3.12/3.13 et SQL complets, et les 500+ connecteurs, l’entrepôt de données centralisé, le module de machine learning, la planification automatisée et le dashboarding natif coexistent dans un seul produit. La courbe d’apprentissage sur les Data Flows complexes est réelle et la communauté d’utilisateurs est plus restreinte qu’Alteryx ou Power BI, mais cette consolidation est tout l’argument. Nous couvrons les capacités spécifiques dans la section ClicData dédiée ci-dessous.

Alteryx

L’éditeur de workflow visuel d’Alteryx reste l’outil de blending et de transformation le plus puissant du marché, ce n’est pas une opinion controversée parmi ceux qui l’ont utilisé sérieusement. AiDIN, le moteur IA intégré, apporte une auto-documentation et des suggestions intelligentes réellement utiles. Ce qui freine Alteryx pour les équipes mid-market, c’est le modèle économique : la tarification par siège devient rapidement coûteuse dès que vous tentez de passer au-delà d’une poignée de power users, et parce que le produit a grandi comme application desktop pour analystes individuels, l’expérience de collaboration porte encore cet héritage même dans les éditions cloud. Il n’y a pas non plus de dashboarding natif, ce qui oblige à recourir à un outil de BI distinct pour la couche de visualisation, réintroduisant précisément le type de handoff qu’Alteryx était censé rendre superflu.

Google Cloud Dataprep (Trifacta)

Pour les équipes dont l’entrepôt est BigQuery, l’interface de wrangling de Dataprep est probablement l’expérience de préparation des données la plus intuitive disponible aujourd’hui. Vous interagissez avec un jeu de données et la plateforme suggère des étapes de transformation avec une précision qui semble presque intuitive, et l’intégration BigQuery est suffisamment native pour ne jamais donner l’impression de travailler au travers d’un connecteur. Le problème est que toute cette fluidité dépend du fait d’être dans Google Cloud. Dès que vos données se trouvent ailleurs, cette intégration étroite devient une contrainte, et comme la visualisation et le ML vivent dans des services Google séparés, votre équipe continue de jongler entre produits pour compléter le workflow.

AWS Glue + SageMaker Data Wrangler

Si la scalabilité brute est la priorité, cette combinaison gère des volumes qui dépasseraient les capacités de tout le reste de cette liste. Glue exécute des jobs Spark serverless tandis que Data Wrangler fournit une interface de préparation visuelle avec plus de 300 transformations intégrées orientées workflows ML. En pratique, cependant, ce que vous achetez ressemble moins à un produit qu’à un projet d’infrastructure, car faire fonctionner S3, Athena, QuickSight et Glue ensemble nécessite un niveau d’expertise technique que toutes les équipes mid-market ne possèdent pas. Quand quelque chose casse, vous déboguez à travers plusieurs services avec des documentations séparées, ce qui est une expérience très différente de celle de travailler dans une plateforme unifiée.

Dataiku

Ce que Dataiku fait bien, il le fait très bien. Les fonctionnalités de gouvernance et de MLOps comptent parmi les plus solides du marché, et la capacité pour des utilisateurs code-first et no-code de collaborer dans le même environnement est quelque chose que la plupart des concurrents affirment offrir sans vraiment le faire. Pour les équipes mid-market, cependant, le défi est la proportionnalité. Si votre besoin principal est la préparation des données et le reporting, la plateforme de data science complète de Dataiku représente bien plus d’outil que nécessaire et vous paierez pour cette étendue que vous l’utilisiez ou non. La visualisation intégrée ne rivalise pas non plus avec un outil de BI dédié pour des livrables destinés aux clients.

Zoho DataPrep

Zoho DataPrep gère la déduplication basée sur les patterns et la standardisation des formats à un prix qui le rend accessible sans avoir besoin de validation de la direction. Si votre équipe utilise déjà les produits Zoho, l’intégration avec Zoho Analytics est naturelle et les licences combinées restent maîtrisables. Les limites apparaissent dès que vos besoins deviennent plus complexes, que ce soit pour du ML personnalisé, une logique de transformation sophistiquée, ou un catalogue de sources de données qui dépasse ce que la bibliothèque de connecteurs Zoho supporte actuellement.

Quelles fonctionnalités rechercher dans un outil de préparation des données par IA ?

Plutôt que de parcourir une liste de fonctionnalités, posez-vous deux questions. Votre équipe peut-elle aller de la donnée brute à un dashboard publié sans quitter un seul produit, ou le workflow nécessite-t-il à un moment d’exporter des données entre outils séparés ? Et lorsque vous tombez sur une transformation que votre plateforme actuelle ne peut pas gérer visuellement, existe-t-il un environnement de scripting à l’intérieur du même produit, ou faut-il basculer dans un autre outil ?

Si vous pouvez répondre à ces deux questions avec un seul nom de produit, vous êtes probablement en bonne posture. Un constructeur de pipeline visuel et les transformations assistées par IA sont attendus dans n’importe quelle plateforme de préparation automatisée des données en 2026, tout comme la planification, une bibliothèque de connecteurs couvrant vos sources réelles, et des contrôles de qualité des données. Si votre équipe se demande encore « qu’est-ce qu’un outil de reporting et en quoi diffère-t-il d’une plateforme de data prep ? », la distinction est importante : les outils de reporting visualisent une donnée déjà propre, tandis que les plateformes de préparation gèrent tout ce qui se passe en amont.

Comment ClicData peut-il vous aider à passer du nettoyage des données à l’intelligence des données ?

Cette section entre dans le détail de ce que ClicData délivre concrètement, car la préparation des données par IA signifie quelque chose de différent selon chaque plateforme et ce sont les détails qui comptent lorsque vous engagez un budget.

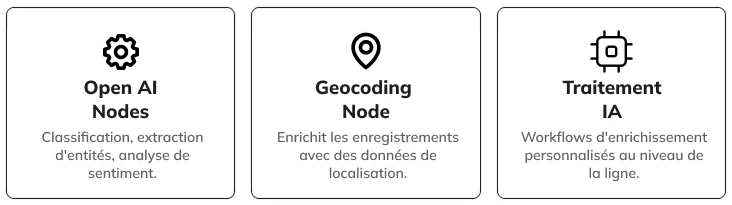

Le module Data Flow est le socle, et les 35+ nœuds qu’il propose ont été conçus autour des problèmes que les analystes rencontrent réellement chaque semaine. Côté nettoyage, des nœuds dédiés gèrent la standardisation des données, la correction de format et la déduplication, exactement les problèmes de formatage de dates, de doublons et d’incohérences de nommage évoqués plus tôt dans cet article.

Ce qui distingue ClicData de la plupart de la concurrence, c’est ce qui se passe ensuite, une fois la donnée nettoyée. La couche d’augmentation par IA réside directement dans le concepteur Data Flow, ce qui signifie que votre équipe peut exécuter de la classification, de l’enrichissement, de l’analyse de sentiment et des traitements géolocalisés au niveau de la ligne ou de la table, sans jamais exporter les données vers un service externe.

Pour les traitements qui dépassent ce que les nœuds visuels peuvent gérer, Data Scripts fournit des environnements d’exécution Python 3.12/3.13 et SQL complets avec des ressources de calcul scalables, suffisants pour des modèles de ML personnalisés ou toute transformation nécessitant un contrôle programmatique. La planification automatisée orchestre les pipelines via des exécutions planifiées, des déclencheurs basés sur des alertes, des Data Hooks et des appels API. Le module de machine learning propose des fonctionnalités de statistiques, de segmentation et de détection de tendances. Au niveau de la roadmap, ClicData développe ClicAI pour l’interaction avec les données en langage naturel et la construction assistée par IA de dashboards, pas encore disponible, mais ce signal montre que la plateforme progresse vers le haut de la courbe de l’intelligence.

Verdict Final sur la Préparation des Données par IA en 2026

La préparation des données a cessé d’être simplement un problème de nettoyage. Les équipes qui prennent de l’avance en 2026 sont celles qui traitent leurs pipelines de préparation comme l’endroit où l’intelligence commence réellement et non comme la corvée qui doit se terminer avant que l’analyse puisse démarrer. Le profilage automatisé, les transformations pilotées par IA et l’enrichissement intégré ne sont plus des fonctionnalités expérimentales en marge du marché ; ils deviennent le socle de ce que les plateformes sérieuses proposent.

La question pour votre équipe n’est pas de savoir si les adopter. C’est quelle plateforme s’adapte à votre façon de travailler réellement et cela se résume à des compromis entre profondeur fonctionnelle, scalabilité, adéquation écosystémique, prix, et la part du workflow qui doit nécessairement vivre en dehors du produit.

Le tableau ci-dessous synthétise comment chaque outil se positionne.

Tableau Comparatif des Plateformes

| OUTIL | IDÉAL POUR | POINTS FORTS IA | LIMITES | MODÈLE TARIFAIRE |

|---|---|---|---|---|

| Alteryx | Équipes grands comptes avec des workflows complexes multi-sources | Moteur AiDIN pour l’auto-documentation et les suggestions intelligentes, blending visuel puissant | Licence par siège onéreuse, héritage desktop qui limite la collaboration, pas de dashboarding intégré | Licence par utilisateur, à partir de ~5 000 $/an |

| Google Cloud Dataprep (Trifacta) | Équipes cloud-native sur GCP ayant besoin de wrangling visuel | Suggestions de transformation d’une précision remarquable, intégration native BigQuery | Verrouillé dans l’écosystème Google, visualisation et ML dans des services Google séparés | Facturation à la consommation sur GCP |

| AWS Glue + SageMaker Data Wrangler | Équipes pour lesquelles la scalabilité brute est la priorité | Jobs Spark serverless, 300+ transformations intégrées orientées workflows ML | Plus un projet d’infrastructure qu’un produit, nécessite une expertise ingénierie pour connecter S3/Athena/QuickSight/Glue, débogage multi-services | Facturation à la consommation AWS |

| Dataiku | Équipes data science à la croisée de l’analytics et du ML | Gouvernance et MLOps solides, collaboration code-first et no-code dans le même environnement | Surdimensionné pour les équipes focalisées sur la préparation et le reporting, la visualisation intégrée ne rivalise pas avec les outils BI dédiés | Licence enterprise, sur devis |

| Zoho DataPrep | Équipes déjà dans l’écosystème Zoho ayant besoin d’un nettoyage IA accessible | Déduplication par patterns, standardisation des formats à prix accessible | Plafond sur le ML complexe, la logique de transformation avancée, et la bibliothèque de connecteurs | Licence Zoho groupée |

| ClicData | Équipes mid-market ayant besoin de la préparation, de l’entrepôt et des dashboards dans une seule plateforme | Nœuds IA (via Azure OpenAI) pour l’enrichissement au niveau ligne dans Data Flow, profilage automatisé, Python 3.12/3.13 avec calcul scalable | Communauté plus réduite qu’Alteryx ou Power BI, courbe d’apprentissage sur les Data Flows complexes | À partir de 249€/mois pour les équipes |

ClicData ne gagne pas chaque comparaison individuelle. L’argument est plus pragmatique que cela : vous ne devriez pas avoir besoin d’assembler quatre produits pour faire tourner un seul pipeline de données. Pour les équipes mid-market qui passent du nettoyage manuel à une véritable intelligence des données, sans constituer un patchwork d’outils déconnectés, cette consolidation est le facteur différenciant.

Envie de vérifier par vous-même ? Réservez une session avec l’équipe ou commencez par l’aperçu de la plateforme. Pour aller plus loin, les guides sur la construction de pipelines de données fiables et le SQL modulaire pour des KPIs cohérents prennent le relais là où cet article s’arrête.